Tout système d’information géographique, aussi perfectionné soit-il, dépend de la qualité des données utilisées. La mise à jour, la précision, la cohérence et l’exactitude des données sont un enjeu primordial…

Après avoir défini les notions de Système d’Information Géographique (SIG) et de géomatique dans un premier article et avoir présenté quelques-uns des nombreux domaines d’utilisation, posons-nous ici la question des données. De leur création à leur utilisation, c’est de leur qualité que dépendent toutes les analyses, les résultats et les informations qui en résultent.

Qu’est-ce que la qualité des données ?

Tout système d’information géographique, aussi perfectionné soit-il, dépend de la qualité des données utilisées. La mise à jour, la précision, la cohérence et l’exactitude des données sont un enjeu primordial. Un jeu de données du réseau routier de Paris précis au centimètre et comportant toutes les caractéristiques possibles des voies n’aura aucune utilité pour calculer les itinéraires d’intervention des pompiers s’il date de 1991 par exemple.

Un relevé de terrain de l’éclairage public pour les services techniques de la mairie effectué trois jours auparavant, intégrant une multitude d’informations pour chaque pylône, ne sera pas exploitable si le GPS utilisé n’est précis qu’à 5m. De la même manière, difficile d’analyser une carte des hôpitaux d’une région dès lors que certains peuvent être répertoriés en plusieurs exemplaires à la fois en tant que clinique, qu’hôpital régional et que dispensaire itinérant.

Autre exemple de mauvaise qualité : une image satellite d’une résolution de 30 cm capturée juste après une inondation mais sans information permettant de la localiser.

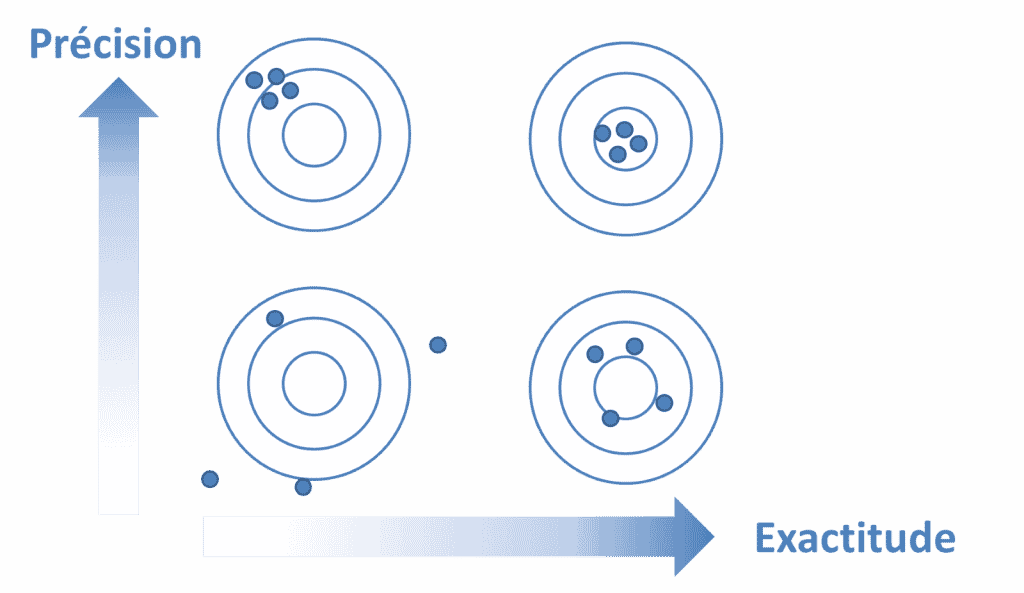

Figure 1 : Exactitude et précision de la donnée

Qui sont les garants de la qualité ?

Mais alors qui crée la donnée ? Qui en vérifie la qualité ? Le créateur de la donnée lui-même et l’utilisateur effectuent des contrôles de qualité. Respectivement lors de la création des données de type vecteur, en remplissant correctement les métadonnées (date, lieu, identifiant unique, précision géographique, nom, etc.) et lors de l’utilisation. À cette étape, il est nécessaire de vérifier que la source de la donnée est connue / reconnue / officielle, que la position géographique est cohérente (que des données de Lyon ne sont pas géolocalisées à Moscou) et que des métadonnées sont associées aux objets géographiques (un relevé terrain contenant 50 points sans nom, sans identifiant ni attributs n’est pas utilisable).

Que ce soit un employé de mairie qui relève les accès pour fauteuils roulants ou un particulier qui exploite une donnée sur les migrations des baleines, tous deux, parfois sans s’en rendre compte, effectuent des contrôles sur la qualité de la données.

En France, l’IGN (Institut National de Géographie) produit et gère une multitude de données fiables disponibles plus ou moins gratuitement : orthophotographie, réseau hydrographique, réseau routier, cadastre, occupation des sols, altitude, etc.

La qualité des images satellites

Pour ce qui est des données de type raster et précisément des images satellites, la qualité ne dépend pas uniquement de la bonne complétion des métadonnées et de la précision géographique. Il faut prendre en compte à la fois la précision des capteurs embarqués, le bon fonctionnement du satellite (trajectoire, inclinaison, vitesse constante), les traitements correctifs appliqués aux images brutes (correction des déformations liées à l’atmosphère et à la projection d’une sphère sur une surface plane) et les traitements esthétiques tels que l’égalisation radiométrique.

Qui voudrait utiliser une image satellite pour analyser l’occupation du sol et calculer les surfaces occupées par l’eau, la forêt ou l’espace urbain alors que l’image n’aurait pas été « remise à plat » (ortho-rectifiée) en prenant en compte le relief ? Tous les calculs seraient faux. Et que se passe-t-il si les nuages n’ont pas été enlevés et occupent 90 % de la zone d’étude ? Le produit est inutilisable. Ici, le sens du terme « qualité » est plus vaste.

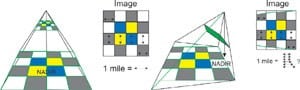

Figure 2 : L’orthorectification – image telle que vue à la verticale du sol, utilisable comme une carte (gauche) vs image acquise avec un angle important qui nécessite une orthorectification (droite).

Source : Orthorectification For Multi Sensor Imagery, M. Mathur, 2010

Comment améliorer une donnée satellite ?

S’il s’agit de proposer un produit « sans nuage », autrement dit de « supprimer les nuages », plusieurs images d’une même zone, à des instants différents, sont nécessaires. Ensuite, vous devez repérer les zones nuageuses et chercher sur les autres images la zone correspondante pour créer une mosaïque. Là encore se pose la question de la qualité. Le produit final est composé de plusieurs images sur une même zone. Et si la saison n’est pas la même ? Si l’ensoleillement est différent ? D’un point de vue esthétique, la mosaïque sera visible, mais pour les analystes qui se basent sur la valeur du pixel pour identifier les essences végétales, cela peut poser problème. Il faudrait alors sélectionner des images d’une même saison uniquement ? Peut-on uniformiser le rendu final ?

Tout est possible tant que l’information est accessible, de type : « il s’agit d’une mosaïque, les dates d’acquisitions sont les suivantes, attention un travail a été effectué pour obtenir un rendu plus esthétique, ne pas utiliser pour analyses », etc. Il est néanmoins possible de faire quelques concessions esthétiques sans pour autant trop s’éloigner des valeurs d’origine qui rendraient certaines analyses caduques.

Une image satellite en couleur (multicanal) peut être de très bonne qualité si elle est précise à 20km, géolocalisée avec exactitude, avec une couverture nuageuse correcte et un rendu de couleur proche du réel. On parlera alors d’améliorer la « qualité », sous-entendu sa résolution, par des processus comme la fusion (pansharpening en anglais) qui permet d’ajouter la couleur sur une image de la même zone, prise au même moment en noir et blanc (monocanal) avec une résolution quatre fois supérieure. À l’inverse l’image monocanal peut être augmentée en y ajoutant la couleur grâce au même processus sans en dégrader la résolution.

Figure 3 : Amélioration de la précision d’une image multispectrale

La qualité d’une image satellite regroupe donc de multiples concepts. Une image précise à 30 cm n’aura que très peu de valeur si elle représente Lyon mais se positionne à Saint Pétersbourg en inversant la bande bleue et la bande rouge ou si aucune métadonnée ne mentionne le capteur utilisé, ni la date de prise de vue. Les fournisseurs d’imagerie satellite contrôlent la qualité de tous ces paramètres à différentes étapes de production.

Certains, comme Airbus, développent également des logiciels d’utilisation et d’analyse des images qu’ils produisent. Des contrôles qualité effectués à la fois manuellement et automatiquement par des experts et des testeurs sont réalisés à la fois sur les images et sur les processus d’analyse proposés.

Figure 4 : Logiciel d’analyse et de traitement des images satellites (source : Airbus)

Comment garantir la qualité

Les normes

Des standards internationaux et nationaux existent afin d’harmoniser les modèles de données et de systématiser l’utilisation des métadonnées pour décrire les jeux de données. À la clé : des échanges et un contrôle qualité simplifiés.

En ce qui concerne la géométrie des données vectorielles, les outils de dessin, de détection des erreurs spatiales et de leur correction sont également de plus en plus performants. À ce titre, le gouvernement, via le CNIG (Conseil National de l’Information Géographique), a mis en place le CNIG1 qui établit des prescriptions nationales pour la dématérialisation des documents d’urbanisme.

« Review by peer »

L’open data existe aussi en géomatique ! OpenStreetMap est une carte mondiale, très riche, créée par des bénévoles ou par le reversement de données libres. La garantie de la qualité relève de révisions multiples par les utilisateurs et d’outils automatiques d’assurance qualité.

- Découvrir OpenStreetMap (la carte mondiale) ou son wiki

La création de données

Le géoréférencement

Il s’agit d’une carte, ou d’une image papier ou numérique non géolocalisée, c’est-à-dire ne comportant aucune métadonnée permettant de la placer sur la surface de la Terre. Soit typiquement, une carte / une image scannée ou présentée dans un format sans coordonnées.

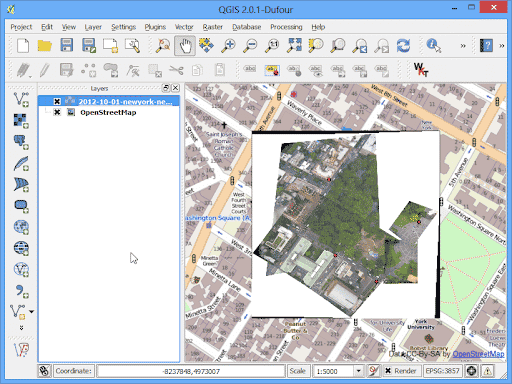

Il s’agit donc de repérer des « objets » à la fois sur l’image qui doit être géoréférencée et sur une source de données dont les coordonnées sont connues. Ensuite, grâce à un logiciel de SIG, il est nécessaire de lier les deux points et de répéter l’opération à plusieurs endroits pour enfin valider.

Figure 5 : Géoréférencement (source qgistutorials.com)

La vectorisation

Une fois cette étape réalisée, il est possible de transformer les informations contenues dans chaque pixel de l’image géoréférencée en données vectorielles utilisables par le SIG. Il s’agit d’obtenir une couche pour les routes, une autre pour les villes ou pour l’occupation du sol (forêt, eau, urbain…).

Plusieurs méthodes sont alors possibles.

La « classification semi-dirigée »

Si l’on souhaite obtenir des données vectorielles de type polygone pour l’occupation du sol à partir d’une image satellite, il est possible d’apprendre à un logiciel SIG à reconnaître un espace urbain, une forêt, une route… Et même au sein d’une exploitation agricole à différencier les espèces. Le résultat de cette analyse dite de « classification semi-dirigée » varie selon la précision du capteur et des bandes enregistrées : proche infrarouge, deep blue en plus du visible… Il est possible ensuite de retravailler les polygones obtenus, et de créer des lignes et des points pour les objets nécessaires.

La topologie

Si l’on souhaite vectoriser rapidement quelques objets seulement, il est possible de tracer à main levée des points, des lignes et des polygones. Ce travail peut rapidement être fastidieux sur une grande surface ou nécessiter l’utilisation d’outils très spécifiques pour respecter les règles de géométrie spatiale (topologie). L’exemple le plus concret est celui du cadastre : deux parcelles adjacentes partagent un côté (ligne commune) mais si elles sont tracées à main levée, il y a un gros risque que les deux parcelles se recoupent à un niveau de zoom élevé. Sur le papier, ce ne sont que deux polygones partiellement superposés. Mais dans la réalité, ce n’est pas possible. La topologie représente donc cet ensemble de règles qui permettent de respecter une géométrie spatiale cohérente.

Le relevé terrain

Il est courant, pour des aspects pédagogiques, de procéder aussi avec une feuille et un stylo. La communauté OpenStreetMap nomme cette technique la « Cartopartie ». Il s’agit d’imprimer une image satellite de la zone à cartographier en ajoutant les données spatiales déjà existantes, d’y reporter les modifications / informations à compléter puis, une fois sur l’ordinateur, de créer / modifier ce qui doit l’être. La communauté est ensuite très réactive pour valider et effectuer des retours.

À l’aide d’un GPS, il est courant de relever les coordonnées des objets d’intérêts. La précision de l’appareil est déterminante et la possibilité de gestion de l’information est très limitée.

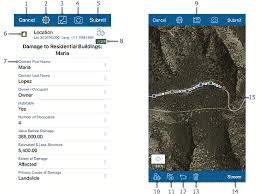

Le développement de nombreuses applications offre une alternative très intéressante au GPS. Elles offrent en effet la possibilité de préparer à l’avance des formulaires et un modèle de gestion de l’information. Et notamment la création de catégories à choix multiple pour éviter les erreurs et les abréviations hasardeuses (« brification » pour « bifurcation », « flaco » pour « lac / retenue d’eau », « hospital » / « ospitale » / « hopital », etc.). Le type d’attributs complémentaires aux coordonnées est également décuplé : association d’un QR code, d’une photo, d’une note audio, etc.

Figure 6 : Capture d’écran OSMTracker

Figure 7 : Capture d’écran ArcGIS Collector, source ESRI

Les résultats d’analyses

Il est également possible de créer de nouvelles données à partir de données déjà existantes. Les outils de fusion, d’union, de découpage, de sélection etc. permettent de cibler, d’extraire ou de regrouper des objets vectoriels pour créer une nouvelle information et, par conséquent, une donnée.

À partir des objets de format raster, il est également possible de procéder à des calculs de type soustraction de deux images superposées pour ne garder que les différences, ou bien de créer des indicateurs de visibilité.

Par exemple, grâce à de véritables équations appliquant des coefficients aux différentes images :

Indice d’accessibilité = 5 x Relief + Couverture_végétale – 2 distance_ville + catégorie_réseau_routier

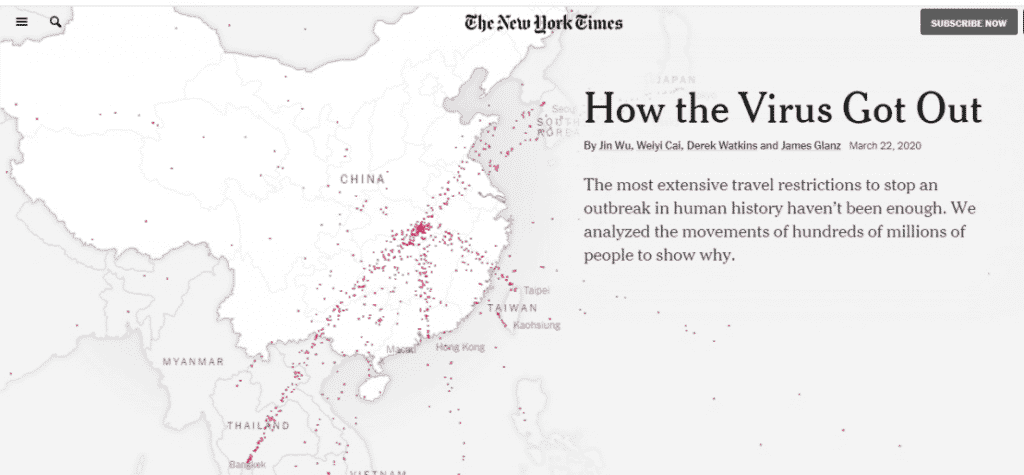

La puissance des SIG

Qu’est-ce que le SIG apporte de plus qu’un tableau Excel pour analyser une situation ? Un SIG répondant aux normes de qualité précitées permet d’explorer des patterns (identifier les facteurs favorisant la circulation d’un virus en cas d’épidémie) et de répondre à des questions. Dans le cas de l’implémentation d’un nouveau point d’eau dans un camp de réfugiés, le SIG permet de prendre en compte le nombre et la distribution des utilisateurs, les points d’eau déjà existants, leur capacité, leur état fonctionnel, ou l’accessibilité qui doit respecter des normes de distance, de dénivelé, de sécurité…

Un SIG permet de raconter une histoire d’une manière incomparable là où un long rapport contenant plusieurs tableaux de statistiques ne pourrait le faire (StoryMap, carte interactive, carte imprimée avec analyse). Seul un SIG peut à la fois montrer où sont les zones les plus affectées par un évènement, pourquoi ces zones sont particulièrement concernées et ce qu’il est possible de faire pour réduire l’impact.

Pour compléter, vous trouverez ci-dessous quelques outils de géomatique.

Un SIG portable : Geopoppy

Découvrez cet outil dans le cadre d’une mission terrain de CartONG en partenariat avec L’AFD.

Le SIG pour l’aménagement du territoire : drone et modèle de terrain

Modélisation de terrain à partir d’images prises par un drone ou comment étudier les possibilités d’aménagement d’un territoire.

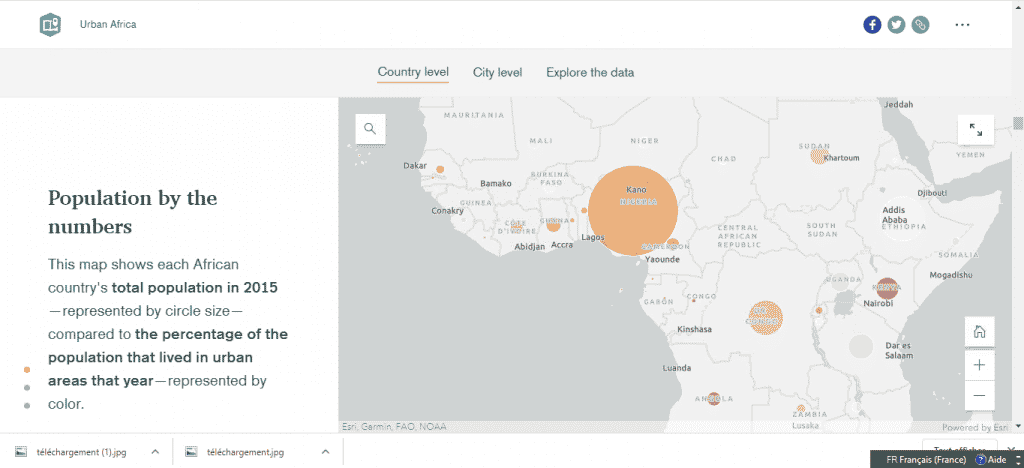

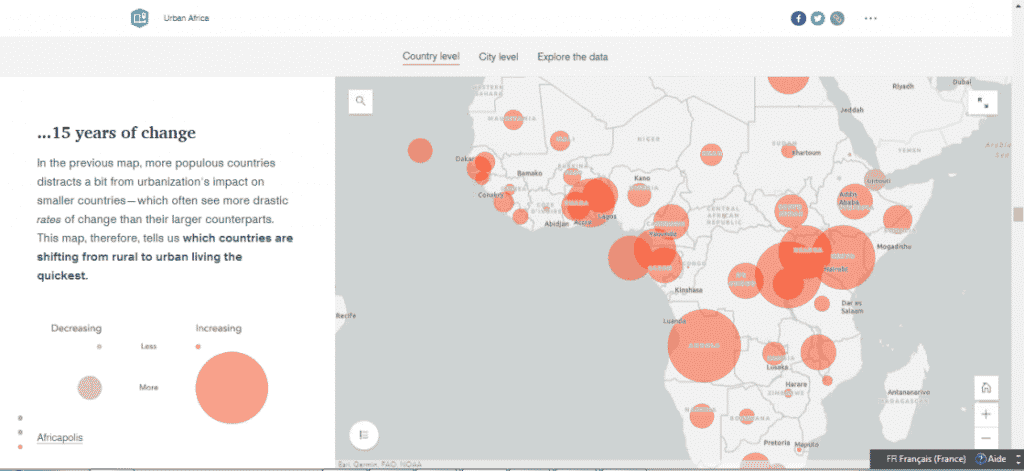

Les StoryMap, outils de communication grand public

Très bel exemple de StoryMap réalisé par Esri’s StoryMaps team en 2020, mêlant récit, photographie, histoire et cartes.

Figure 8 : Esri’s StoryMaps team, 2020

La StoryMap du New York Times sur la diffusion du coronavirus depuis Wuhan.

Une StoryMap sur la crise migratoire au Venezuela permet de suivre le parcours migratoire de carte en carte avec inclusion d’objets vidéographiques.

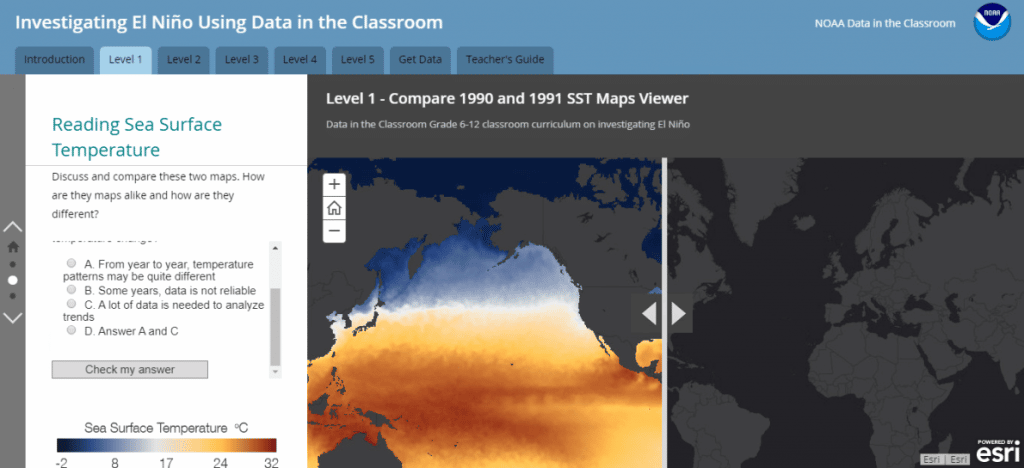

La NOAA propose également du contenu pédagogique sur des phénomènes comme El Niño avec des cartes dynamiques (curseur dans l’exemple ci-dessous).

Pas encore de commentaires